智能驾驶:人工智能发展的晴雨表

咱们得承认,智能驾驶乃至自动驾驶,其实是人工智能大家族里特别关键的一块版图。

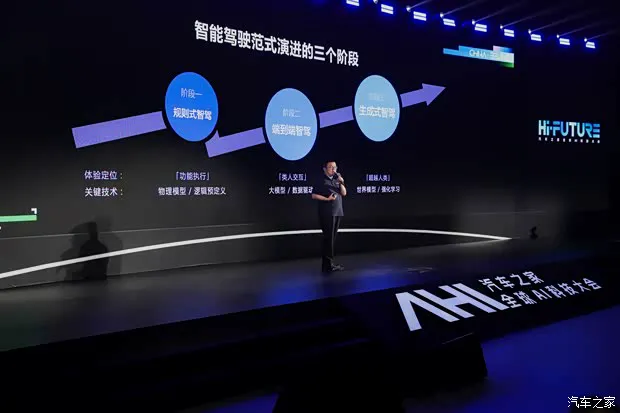

它技术路线的变迁,其实就是人工智能发展三个阶段的最直观反映。这不仅仅是车怎么开的问题,更是 AI 技术如何理解物理世界、如何做出决策的核心体现。

行业窗口期:机遇与挑战并存

当前,伴随L2 级辅助驾驶的加速普及,智能驾驶技术正迎来一个关键的窗口期。

这时候的行业氛围挺有意思,既涌动着对技术突破的期待与积极探索,也存在对技术落地、安全应用等方面的审慎讨论。大家心里都清楚,技术跑得快是好事,但跑得稳才是本事。

为了凝聚共识、共促发展,汽车之家于 9 月 21 日举办了“汽车之家全球 AI 科技大会”。这次大会以"Hi Future"为主题,汇聚了行业顶尖技术专家、车企领袖及生态伙伴,主要就是想探索这么两件事:

- 智能技术如何筑牢安全底线

- 智能技术如何重塑竞争边界

核心痛点:我们需要什么样的世界模型?

在本次大会上,商汤科技联合创始人、执行董事、CTO,商汤绝影 CEO 王晓刚分享了主题为《世界模型:智能驾驶范式演进新路标》的演讲。

他提到了一个非常核心的观点:我们需要有个非常强大的、质量非常高的世界模型,来重构我们的万千世界。

为什么要这么做?目的很明确,就是能够让安全有更多的确定性。在复杂的道路环境中,只有真正理解了世界的运行规律,智能驾驶系统才能在面对突发状况时,给出最靠谱的反应。

范式演进:从感知到认质的跨越

王晓刚的分享其实给行业指了一个新路标。以前的智能驾驶可能更偏重于感知,看到障碍物就躲。

但未来的范式演进,必须依托于世界模型。这意味着车辆不仅要“看见”,更要“理解”。通过重构万千世界,系统能够预测接下来可能发生什么,从而把安全的主动权掌握在自己手里。

这场大会以及专家的分享,无疑为智能驾驶的下半场发展,提供了重要的理论支撑和实践方向。

咱们今天来深入聊聊王晓刚对于“世界模型”在自动驾驶领域应用的独到见解。在他看来,世界模型不仅仅是一个技术概念,更是推动自动驾驶迈向新阶段的关键驱动力。

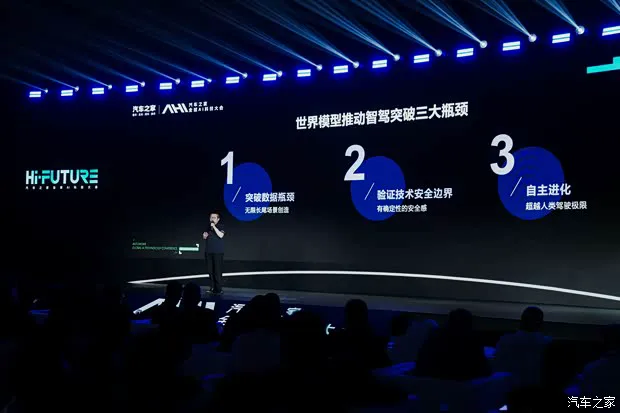

世界模型带来的三大突破

首先,王晓刚认为世界模型能在三个关键维度上推动自动驾驶取得实质性突破:

第一,突破数据瓶颈。大家都知道,长尾场景的数据收集很难,但世界模型可以产生无限长的长尾场景,解决了数据来源的根本问题。

第二,验证技术边界。世界模型能够通过仿真模拟还原物理世界,让我们在仿真环境里不断地尝试和试错,从而摸清技术的天花板在哪里。

第三,超越人类驾驶体验。通过引入强化学习,系统可以在模型中不断进化,最终达到超越人类驾驶的水平。

构建高质量世界模型的核心目标

我们为什么要费这么大劲去做这件事?核心目标很明确:我们需要一个非常强大且高质量的世界模型,用它来重构我们面对的万千世界。只有这样做,才能让自动驾驶的安全拥有更多的确定性,而不是靠运气。

对世界模型的三大硬核要求

当然,理想很丰满,实现起来也有具体标准。在王晓刚看来,一个合格的世界模型必须满足以下三方面的要求:

1. 面向量产的数据生成能力。生成的数据不能只是实验室里的玩具,必须能够一键生成复杂的场景,直接服务于量产需求。

2. 高度的可编辑性与拓展性。场景里包含的各种因素必须是可以被编辑的,能够通过自由组合各种因素,实现场景的无限拓展,覆盖更多极端情况。

3. 高效的实时交互能力。这也是硬指标,在一定空间内必须具备非常高效的推理效率,支持在一个世界模型里面进行实时互动,不能卡顿,不能延迟。

总的来说,世界模型不仅是技术的升级,更是自动驾驶安全落地的基石。只有满足了这些苛刻的条件,我们才能真正放心地把方向盘交给 AI。

世界模型与具身智能:自动驾驶技术的演进与启示

大家好,今天我们来深入探讨一下世界模型在具身智能领域的应用前景。王晓刚的观点非常明确:今天在自动驾驶场景中构建的世界模型技术体系,完全可以迁移到具身智能领域,而且后者对世界模型的需求实际上更为迫切。

为什么具身智能更需要世界模型?

这背后的逻辑其实很清晰。主要是因为机器人的数量相对较少,且每个机器人的硬件配置千差万别。在这种差异化巨大的背景下,未来通过大量的模拟仿真数据,将成为推动自动驾驶与具身智能跨越到下一个阶段的关键动力。

自动驾驶技术的三个阶段演进

我们认为,自动驾驶技术的演进频率非常快,它实际上是人工智能发展三个阶段的一个缩影。为了方便大家理解,我们可以将其划分为不同的发展阶段:

1. 基于规则的智能驾驶阶段:这是大家比较熟悉的第一个阶段。我们通过 AI 输出感知结果,然后通过各种预定义的规则逻辑,结合优化的物理模型来实现规划控制。

2. 智能来源的追问:在人工智能发展的每个阶段,我们都要问一个问题:智能到底是从哪里来的?在第一个阶段,很多的智能实际上来自于人工。

3. 人工智 1.0 的特征:我们需要大量标注感知数据得到输出,人工书写各种各样的规则。那时候有一句话很流行:有多少人工,就有多少智能。

这其实很像人工智 1.0 发展的阶段,比如人脸识别、视频分析,我们针对安防场景、人工场景输入智能的数据,都是依赖于大量的人力投入来构建系统的智能能力。

总结与展望

从基于规则到数据驱动,技术的变迁反映了人工智能发展的核心脉络。利用自动驾驶积累的技术体系赋能具身智能,并通过仿真数据实现规模化突破,将是未来行业发展的关键路径。

人工智能发展的三个阶段与自动驾驶的未来

我们今天来聊聊人工智能在自动驾驶领域的演进历程。如果把人工智能的发展划分为不同阶段,那么第二阶段正是大模型爆发的时期。就像我们在 AI 2.0 时代看到的 ChatGPT 一样,它实际上是积累了互联网上过去多年人类行为的数据,比如海量的文章和代码,这些都是人类智能的体现。

在自动驾驶领域,这个阶段对应的就是人类的驾驶行为数据。大家推动的是端到端的自动驾驶,其核心逻辑是把过去长时间积累的人类行为智能,转化成为模型的智能。这确实带来了一次巨大的智能和体验上的跃迁。但是,这种模式也存在明显的瓶颈。

人类行为是智能的天花板,也是数据的瓶颈

为什么这么说?因为人类的行为本身就是智能的上限,而且这种模式大量依赖数据。今天大模型发展遇到瓶颈,正是因为互联网上积累的数据价值面临枯竭。同样,自动驾驶积累的大量数据也有它的极限。这就引出了第三阶段的发展。

第三个阶段,我们要通过世界模型、生成式智驾以及强化学习来进一步突破。举个典型的例子,2015 年 AlphaGo 出现,后来 evolved 成 AlphaGo Zero,它不需要任何人类知识的输入,也能产生大量的智能。在围棋里,棋盘和规则是人类定义的,这是更高阶的智能。

我们希望在自动驾驶里也能通过强化学习突破人类驾驶的上限,这就需要一个世界模型。这个世界模型能够模拟物理世界的规律、人类行为的法则。强化学习在仿真世界模型的环境里不断提升,从而突破人类驾驶的上限。类似的,今天人工智能 3.0 发展提出的具身智能,就是要从原来的互联网数据走出来,通过跟物理世界的交互产生新的智能,而世界模型在这里会扮演非常重要的角色。

端到端自动驾驶面临的核心挑战

今天端到端的自动驾驶主要面临几个棘手的问题:

第一,我们需要大量的数据。像特斯拉有几百万台车,且传感器配置一致,能够回流海量数据。但大多数厂商没有如此规模的数据积累。

第二,危险复杂场景的获取成本极高。对于那些 Corner Case( corner 案例),获得成本非常高,风险也非常大,怎么获得这些高质量的数据是我们需要解决的难题。

第三,安全的边界不确定。今天端到端的自动驾驶遇到一个问题场景,我们需要采集很多类似的数据重新训练模型。但模型训练完之后,也不能确定这个场景是否能够真正被解决,因为端到端存在不确定性。我们不知道大模型端到端的边界点在哪里,这是两个比较重要的核心问题。

未来方案:世界模型与强化学习的结合

接下来我们要讲的是,未来要把世界模型和强化学习跟端到端相结合。在这里,核心还是要有一个端到端的多模态大模型。它的输入可能是各种视觉的、激光的、语言文字导航的信息,输出就是车辆的行为。

这个端到端的大模型会预测车辆的轨迹,基于预测的轨迹反馈给世界模型。世界模型能够模拟仿真出我们的物理世界将会怎样的变化,给我们反馈出基于世界模型里合成出的视频,进而反馈重新训练端到端的模型。而且这里我们会有个方法,告诉我们什么样的仿真模型是好的。

如此循环往复的迭代,能够不断的提升端到端的性能。同时,在这个仿真环境里面可以无数次的试错。有个问题的场景以后,通过无数次的尝试一定能够解决我们所关心的问题。而且能够做到举一反三、举一反十甚至反百。

所以今天的世界模型并不是无中生有。如果你用了问题场景,我们可以通过复现物理场景,不改变各种要素,如天气、道路、车速等等,把类似的问题得到比较彻底的解决。

实战案例:如何用世界模型解决施工占道问题

接下来我给大家举一个例子,看一看我们怎么用世界模型和强化学习解决问题。这里展示的是一个问题的场景:有个施工占道出现了急刹。我们分几步走:

第一步,需要做 4D 仿真的浮现。通过 3DGS 通过静态的场景浮现,同时通过 3D 的目标进行呈现。这两个相结合浮现场景,通过世界模型对它进行修复,就能够得到更高质量的 4D 空间。

第二步,在 4D 空间里就可以尝试各种不同驾驶的行为,调整端到端的模型,尝试各种不同的驾驶行为,直到你在这个环境里找到**的驾驶行为的结果。因为我们有这个办法可以评价什么样的驾驶行为是好的。

第三步,泛化与验证。在单一的场景里面我们能够得到模型的更新和验证之后,接下来我们需要对它进一步的得到多个泛化。其实有很多其他的类似场景,比如说复杂的施工区域,换道的通行,围栏的减速等等。

这些不同的场景都是通过世界模型所生成出来的各种泛化的场景,我们的模型能够在这些泛化场景里面进一步的学习进行测试。这样一来,我们就构建了一个能够自我进化、不断突破人类驾驶极限的智能系统。

世界模型:自动驾驶突破的三大关键推手

咱们今天来深入聊聊,为什么说现在的世界模型能够推动自动驾驶技术取得实质性的突破。这可不是空穴来风,而是因为它确实解决了行业里最头疼的几个老大难问题。具体来说,主要体现在以下三个核心维度。

第一,彻底打破数据瓶颈

大家都知道,自动驾驶训练最需要的是数据,尤其是那些罕见的长尾场景,现实中很难收集齐全。但有了世界模型,情况就完全不同了。它具备了强大的生成能力,可以凭空产生无限多的长尾场景。这意味着我们不再被动等待罕见事故发生的素材,而是主动创造数据,让算法没见过的问题也能提前学会怎么解决。

第二,精准验证技术边界

技术到底能做到什么程度?安全边界在哪里?以前只能靠路测,成本高还危险。现在,世界模型能够通过仿真模拟恢复真实的物理世界。在这个高保真的仿真环境里,我们可以不断地尝试进行实现,全天候地进行压力测试。这不仅降低了验证成本,更重要的是能让我们清晰地摸到技术的天花板和边界在哪里。

第三,实现超越人类的驾驶体验

最终的目标是什么?当然是比人开得更好。通过引入强化学习,系统可以在仿真环境中自我进化,不断优化决策策略。这种迭代速度是人类司机无法比拟的,最终能够达到超越人类驾驶的体验。无论是反应速度还是决策的最优解,机器都能做得更出色。

总的来说,世界模型不仅仅是技术的升级,更是自动驾驶发展路径的一次重构。从数据生成到仿真验证,再到最终的性能超越,它为我们描绘了一个更安全、更高效的未来出行图景。

构建自动驾驶的核心引擎:高质量世界模型

说白了,这背后的核心逻辑就在于,我们需要构建一个极其强大且高质量的世界模型,以此来重构我们面对的万千世界。只有这样,才能让自动驾驶的安全性拥有更多的确定性。那么,面对这样一个宏大的目标,我们对世界模型具体有哪些苛刻的要求呢?主要集中在以下几个关键维度。

首先,生成的数据必须面向量产。这意味着模型不能只在实验室里跑通,而是要能覆盖更多的场景,尤其是那些非常复杂的场景。关键在于可控性,我们要能够做到一键生成复杂的驾驶场景,而不是靠运气碰巧生成。其次,场景内部的元素需要具备高度的可编辑性。场景里有各种因素,我们需要能针对各种因素进行单独编辑,并通过自由的组合来实现更多的拓展,这样才能满足多样化的测试需求。第三,必须具备实时互动能力。在一定空间内,模型要有非常高效的推理效率,支持在一个世界模型里面进行实时的互动,这对于闭环测试至关重要。

技术难点:多摄像头时空一致性

这里给大家展示一个具体的例子,比如车辆 Cut-in 这种比较危险的场景。我们可以看到车里有 7 个摄像头,要想生成一个好的世界模型,核心挑战在于保持时空的一致性。大家知道,早在 2024 年就有 Sora 能够做各种视频的生成,但今天用世界模型做自动驾驶,难点在哪里?生成视频比图像更难,就是因为有连续性的要求。

而在自动驾驶环境里,视频生成的难度更是倍增,因为有众多的摄像头,必须保持多个摄像头之间的时空一致性。举个例子,车牌号、道路的限行标志,在各个摄像头里内容应该是一致的,还有空间的几何关系也必须是一致的。只有这样,生成的视频才能够有效地用作自动驾驶的训练和测试,否则就是无效数据。

举一反三:从场景编辑到复杂碰撞

基于此,我们就可以针对打车 Cut-in 一个场景,灵活地改变各种要素。我们可以换不同的天气条件、不同的道路路形、大车的车型、车速和 Cut-in 的距离。刚才说了,有了这个能力以后,就可以做到举一反三、反一百、反一千,极大地提升了数据生成的效率和覆盖面。

这里也可以看到,系统能够一键生成更加复杂的场景,比如说车祸和碰撞的场景。这种能力不仅解决了长尾场景数据稀缺的问题,更为自动驾驶算法的鲁棒性提供了坚实的验证基础。通过这种高保真、可编辑、实时的世界模型,我们才能真正迈向更安全、更可靠的自动驾驶未来。

场景要素的任意编辑与灵活操控

在这个平台中,我们核心解决的是对场景内部各种要素的任意编辑能力。想象一下,你可以直接在虚拟场景里锁定任意一辆车,任意替换成不同的车型,或者根据测试需求随心所欲地增加、减少车辆数量。通过这种高度灵活的操控,我们能够模拟出千变万化的驾驶环境,为算法的验证提供无限可能。

实时推理与贴近真实的物理环境

在技术落地层面,我们现在已经完全具备了实时推理的能力。以上海市区为例,系统支持车辆在复杂的城市道路中自由行驶,包括加减速、转弯等动态操作。最关键的是,你今天看到的这些视频内容,其背后的物理引擎跟真实世界的物理环境更加接近,这种高保真的物理反馈对于自动驾驶系统的训练至关重要。

世界模型的产品化与 API 开放

为了让技术更好地赋能行业,我们把世界模型进行了产品化封装,并正式开放了 API 接口。这意味着什么?意味着用户只需要通过文字描述你所想采用的数据场景,系统就能一键生成形成各种各样我们期待的视频内容。这大大降低了使用门槛,让高质量的数据生成变得触手可及。

百万级数据集与超高清影像规格

经过长期的技术积累,我们现在能够构建百万级的数据集,覆盖了各种复杂的长尾场景,真正实现了高保真模拟。在具体的影像规格上,今天每一个 Clips 的时长达到150 秒,拥有7 个摄像头的多视角同步,并且图像质量能够保持比 1080P 更好的效果,为模型训练提供了坚实且高质量的数据基础。

基础设施与数据闭环:构建自动驾驶的坚实底座

当前,自动驾驶行业的演进离不开底层基础设施的完善。我们观察到,各地政府正在积极建立实训场,搭建能够提供强大算力的平台,并支持真实的实车数据采集。

在数据策略上,行业正在采用一种高效的混合模式:一半数据来自真实采集,另一半则通过世界模型模拟仿真生成。这两种数据源相结合,能够为车厂提供高质量的数据集,用于端到端模型的训练。

技术迁移:从自动驾驶到具身智能的跨越

今天在自动驾驶场景中开发出的世界模型技术体系,具有极强的通用性,完全可以迁移应用到具身智能领域。事实上,具身智能对世界模型的需求比自动驾驶更为迫切。

这主要是因为机器人的数量相对较少,且每个机器人的硬件配置千差万别。因此,我们希望在具身智能领域,世界模型能够实现以下关键能力:

• 多模态处理能力

• 数据对齐能力

• 4D 空间理解能力

• 快速推理能力

场景模拟与未来展望

为了说明世界模型的能力,我们可以参考两个具体案例。首先,当输入一条指令让机器人在公园跳跃时,模型能够自动生成机器人的骨骼、姿态及动作变化,并基于此生成机器人第一视角和第三视角的视频数据。其次,在机器臂切黄瓜的任务中,同样可以生成对应视角的仿真数据。

展望未来,利用大量的模拟仿真数据,将成为推动自动驾驶和具身智能跨越到下一个阶段的关键动力。这种数据驱动的模式,将为行业的智能化演进提供无限可能。